在人工智能军备竞赛白热化的今天,三家巨头已然形成鼎立之势:谷歌的Gemini、OpenAI的ChatGPT与Anthropic的Claude。每家公司都宣称自己的模型具备“最先进”的能力,但对于开发者而言,技术指标之外,实用性的选择标准更为关键——哪款模型最适合我的项目?成本效益如何?生态兼容性怎样?

它们看起来都能“写代码、做问答、生成内容”,但在模型能力、使用限制、API 体验、稳定性与适用场景上,差异其实非常明显。

本文将从开发者真实使用视角出发,系统对比 Gemini、ChatGPT 与 Claude,帮助你在不同项目与业务阶段做出更合适的选择。

一、三大模型的背景与定位差异

在对比能力之前,先理解它们的产品基因,往往能解释很多使用体验上的差异。

1、ChatGPT(OpenAI)

- 核心定位:通用型大模型平台

- 优势方向:推理能力、代码理解、多模态、生态完整

- 覆盖人群:开发者、产品经理、内容创作者、企业用户

ChatGPT 更像一个“万能型 AI 助手”,追求的是能力广度与稳定性。

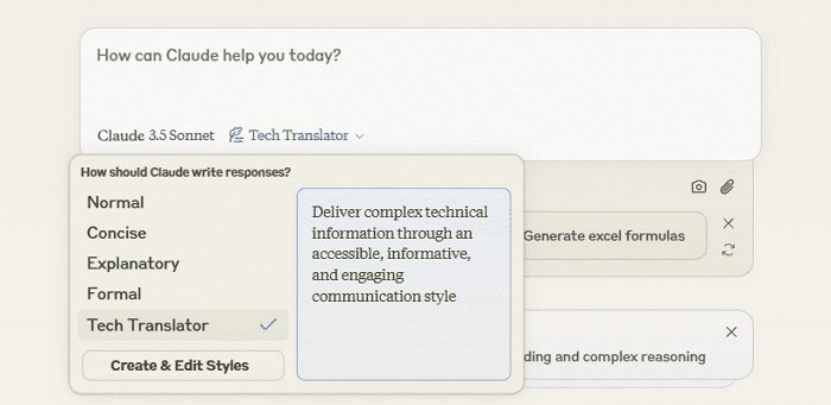

2、Claude(Anthropic)

- 核心定位:安全导向 + 长上下文理解

- 优势方向:长文档处理、逻辑一致性、文本润色

- 覆盖人群:开发者、研究人员、内容密集型团队

Claude 在设计上更强调“可控、稳健、不乱发挥”。

3、Gemini(Google)

- 核心定位:与 Google 生态深度绑定的 AI

- 优势方向:搜索理解、多模态、与 Workspace / Android 的协同

- 覆盖人群:Google 生态用户、Web / Android 开发者

Gemini 更像是 Google AI 能力的“入口层”。

二、核心能力对比

1. Claude 3.5/3.7

对于很多开发者来说,Claude 是目前的“Coding King”。

- 代码质量: Claude 在处理复杂的逻辑架构、Debug 以及重构代码时,表现出极高的准确性。它的输出往往更符合代码规范,且废话较少。

- Artifacts 实时预览: 这是一个杀手级功能。开发者可以直接在侧边栏看到生成的 React、HTML 页面或图表,极大缩短了前端原型开发的周期。

- 长上下文: 拥有 200K 的上下文窗口,足以吃下整个项目文档。上下文长度与长文本处理是 Claude 的核心优势领域。laude:支持极长上下文,适合阅读技术文档,分析协议、规范,处理长业务说明,文档密集型开发或审稿。

2. ChatGPT (GPT-4o/o1)

OpenAI 依然是生态最丰富的玩家。

- 推理能力: 在处理高难度算法、数学竞赛级别的问题时,o1 的“思维链”模式提供了其他模型难以企及的深度。写代码、改 Bug、解释复杂逻辑这是它的强项。但在不确定问题上,偶尔会“自信输出”

- 生态与 API: OpenAI 的 API 文档最齐全,库支持最广。无论是 Python 还是 Node.js,集成起来几乎没有心智负担。

- 多模态: 在音频、图像、视频的全能处理上,GPT-4o 的综合响应速度和一致性依然领先。

3. Gemini (Flash/Pro)

Google 的 Gemini 正在通过生态系统打一场漂亮的翻身仗。

- 百万级上下文: Gemini 支持高达 1M 甚至 2M 的上下文。这意味着你可以把整个代码库、数小时的视频或上千页的 PDF 一次性喂给它,这在进行旧项目迁移时极具优势。

- 速度与成本: Gemini 提供了极佳的延迟表现(TTFT 极低),且在 API 价格上非常有竞争力,适合高频调用的自动化任务。

- Google Workspace 集成: 如果你的开发流程深度依赖 Google Cloud 或 Firebase,Gemini 是原生之选。

以下是具体的对比表格:

| 维度 | Google Gemini Advanced | OpenAI ChatGPT (GPT-4) | Anthropic Claude (3 Opus) |

| 核心优势 | 原生多模态、Google生态深度融合、信息实时性 | 强大的逻辑推理、最成熟的开发者生态与插件体系 | 超长上下文、顶尖的安全性/无害性、文档处理专家 |

| 突出能力 | 图像/视频理解、代码生成、多语言、无缝搜索整合 | 复杂指令遵循、创意写作、结构化输出 | 超长文本总结与分析、复杂逻辑推理、高合规要求场景 |

| 上下文窗口 | 约100万tokens(Gemini 1.5 Pro) | 128K tokens(GPT-4 Turbo) | 200K tokens(标准),部分版本支持100万 |

| API与成本 | 定价有竞争力,Google Cloud用户有集成优势 | 价格较高,但计费模式成熟、工具链丰富 | 定价居中,长上下文场景下性价比显著 |

| 可用性与访问 | 部分高级功能存在区域限制,依赖谷歌账号体系 | 访问最广,但账号风控严格,部分地区受限 | 区域限制相对较少,但同样有访问控制 |

| 最佳适用场景 | 结合搜索的实时应用、多模态任务、谷歌云生态项目 | 创新型应用开发、需要丰富插件或第三方集成的项目 | 长文档深度处理、法律/金融等高风险合规领域、深度对话 |

三、场景化选择指南

1、选择 Gemini Advanced,如果:

- 你的项目重度依赖Google生态(如需要直接处理Gmail、Docs数据,或部署在Google Cloud上)。

- 原生多模态理解是核心需求,如图像/视频内容分析、跨模态生成任务。

- 追求信息实时性,需要模型结合最新网络搜索结果进行回应。

2、选择 ChatGPT/GPT-4,如果:

- 开发生态和社区支持是你的首要考量,你需要海量的插件、开源工具和现成解决方案。

- 日常开发、写代码、调试、原型验证

- 项目侧重于复杂逻辑链推理、创意生成或需要高度遵循复杂指令。

- 你的目标是为C端用户构建功能新颖、互动性强的应用。

3、选择 Claude (Opus),如果:

- 你需要处理超长文本(如数百页的学术论文、代码库或法律合同),并进行深度分析、总结和Q&A。

- 内容的安全性和无害性是绝对红线,适用于法律、金融、医疗等高风险合规领域。

- 你追求与模型进行极其深入、连贯的长时间对话,需要模型具备强大的记忆和一致性。

四、 进阶必备:为什么开发者需要优质代理 IP?

在调用这些顶尖 AI 模型的 API,或是进行 AI 驱动的自动化开发(如 Web Scraping + LLM 分析)时,开发者往往会遇到地域限制、API频率限制(Rate Limiting)或IP被封禁等痛点。

这时候,IPFoxy作为专业的代理服务商,能为开发者提供关键支持:

- 突破地域封锁: 部分 AI 模型 API 在特定地区访问受限。通过IPFoxy的纯净海外住宅 IP,开发者可以模拟全球任意地区的访问环境,确保 API 调用稳定不掉线。

- 规避爬虫限制: 当你利用 AI 进行大规模网页数据抓取并实时分析时,目标网站会对频繁请求进行拦截。IPFoxy 提供的高匿名住宅代理可模拟真实用户行为,有效避免触发反爬机制。

- 多账号管理: 如果你的业务需要同时运行多个平台的 AI 助手账号,IPFoxy 的独享静态IP能为每个账号分配独立的身份,降低账号关联封禁风险。

选好模型是第一步,而配备像 IPFoxy 这样稳定、高速的底层网络支持,则是确保 AI 项目高效落地的关键保障。

五、总结

在AI能力日益同质化的未来,“模型选择”与“网络基建”的协同优化,将成为开发者与企业构建可持续竞争优势的关键。选择一个可靠的网络伙伴,能让你的AI能力在全球范围内无缝部署,释放全部潜力。